Ollama 本地部署

Ollama介绍

Ollama 是一个开源的本地大型语言模型(LLM)运行框架,它旨在简化在本地运行大型语言模型的过程。Ollama 提供了一个简洁易用的命令行界面和服务器,让你能够轻松下载、运行和管理各种开源大型语言模型,如 Llama 3、Mistral、Qwen2 等。

Ollama 的一些主要特点包括:

开源免费:Ollama 及其支持的模型完全开源免费,任何人都可以自由使用、修改和分发。

简单易用:无需复杂的配置和安装过程,只需几条命令即可启动和运行 Ollama。

模型丰富:Ollama 支持多种热门开源大型语言模型,并提供一键下载和切换功能。

资源占用低:相比于商业大型语言模型,Ollama 对硬件要求更低,即使在普通笔记本电脑上也能流畅运行。

社区活跃:Ollama 拥有庞大且活跃的社区,用户可以轻松获取帮助、分享经验和参与模型开发。

Ollama安装

Ollama 官网:https://ollama.com/

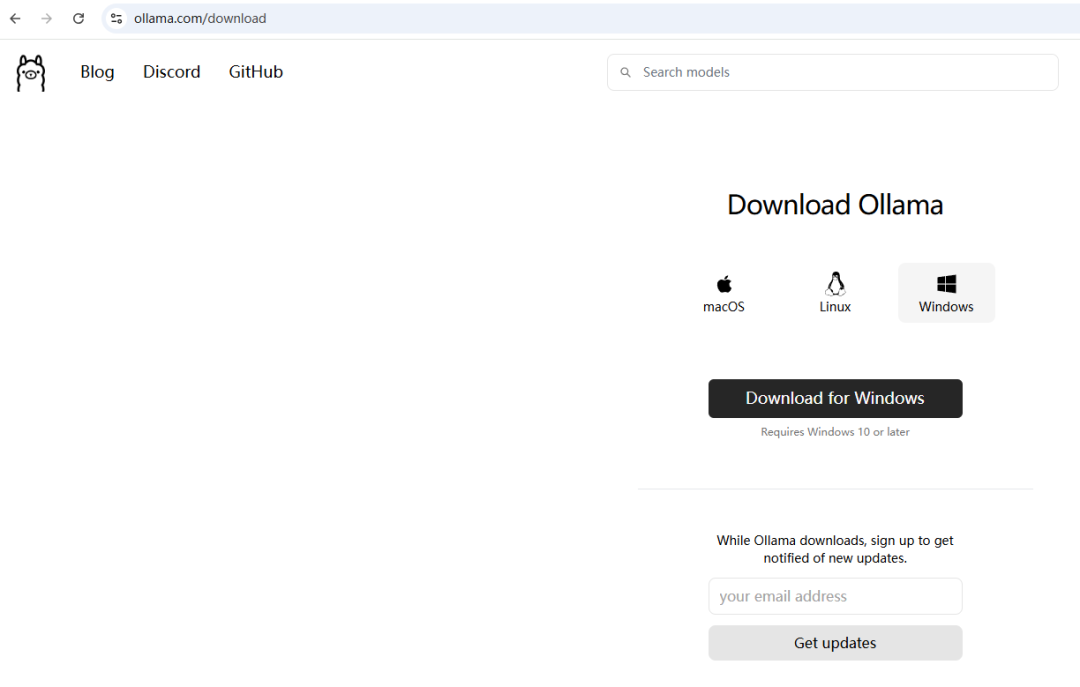

1、到官网下载 Ollama ,根据自己的平台选择需要下载的安装包

Ollama 下载地址:https://ollama.com/download

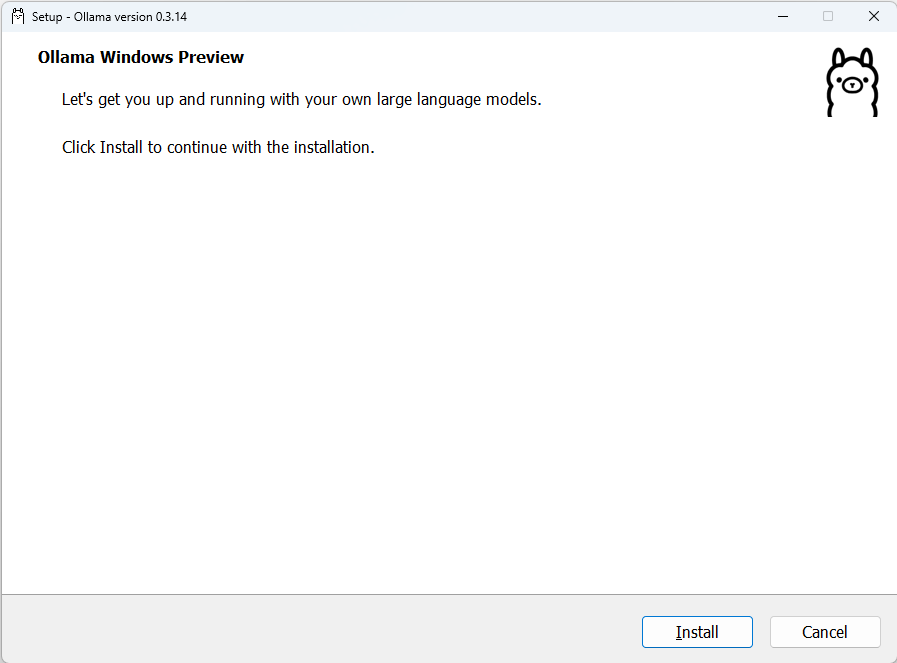

2、下载完之后,双击运行安装即可

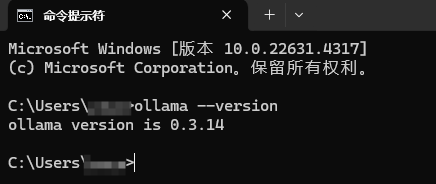

3、安装完后,打开 cmd ,输入 ollama 下面表示 Ollama 已经安装号

4、启动了 Ollama ,在 浏览器中输入 指定网址显示 Ollama 正在运行中

网址:http://localhost:11434

模型下载

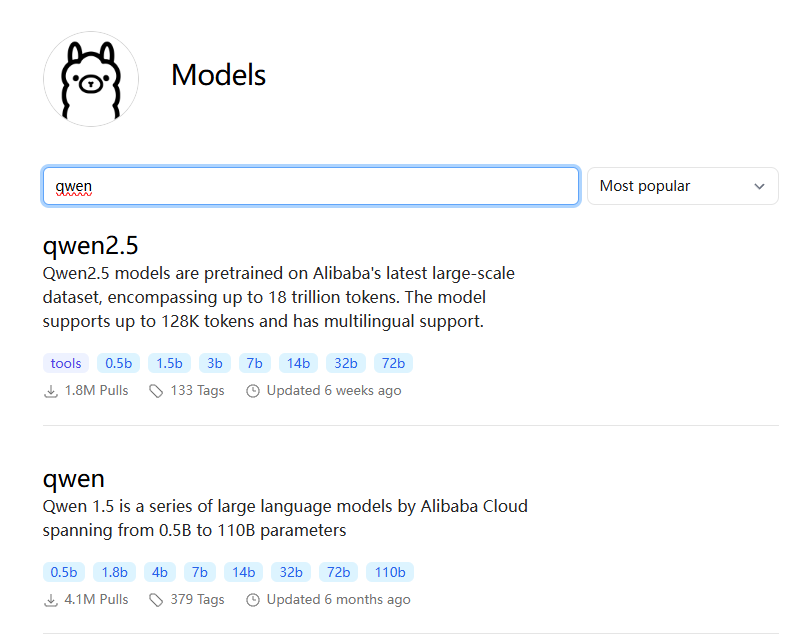

1、在ollama官网搜索qwen

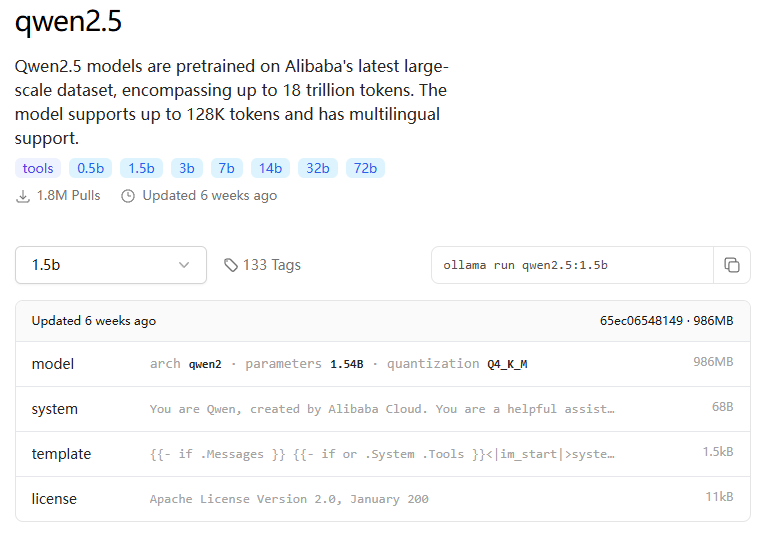

2、我们选择qwen2.5 1.5b

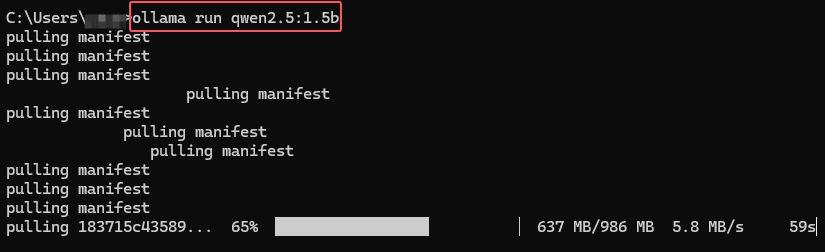

3、执行以下命令下载模型

ollama run qwen2.5:1.5b

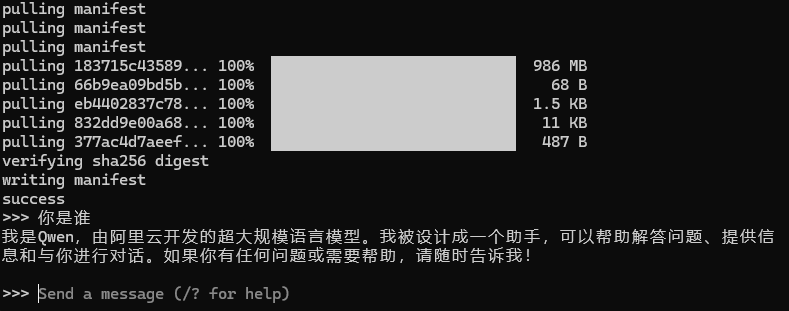

模型体验

模型下载成功后,就会可以输入问题进行提问了

关注公众号「碳基硅坊」,获取更多IT技术与AI实践干货!