Dify智能体开发平台安装

1.Dify介绍

Dify 是一个开源的大语言模型(LLM)应用开发平台,它旨在简化和加速生成式 AI 应用的创建和部署。这个平台结合了后端即服务(Backend as Service, BaaS)和 LLMOps 的理念,为开发者提供了一个用户友好的界面和一系列强大的工具,使他们能够快速搭建生产级的 AI 应用。

Dify 的核心功能包括:

低代码/无代码开发:通过可视化的方式允许开发者轻松定义 Prompt、上下文和插件等,无需深入底层技术细节。

模块化设计:采用模块化的设计,每个模块都有清晰的功能和接口,可以根据需求选择性地使用。

丰富的功能组件:包括 AI 工作流、RAG 管道、Agent、模型管理、可观测性功能等,帮助开发者从原型到生产的全过程。

支持多种大语言模型:已支持 OpenAI GPT 系列等模型,并计划进一步扩展。

数据处理和特征工程工具:提供了数据清洗、特征选择、特征变换等功能,帮助开发者更好地准备数据。

集成外部知识源:允许自定义 API 接入外部知识源,让大型语言模型深入理解企业知识和业务。

- 安装

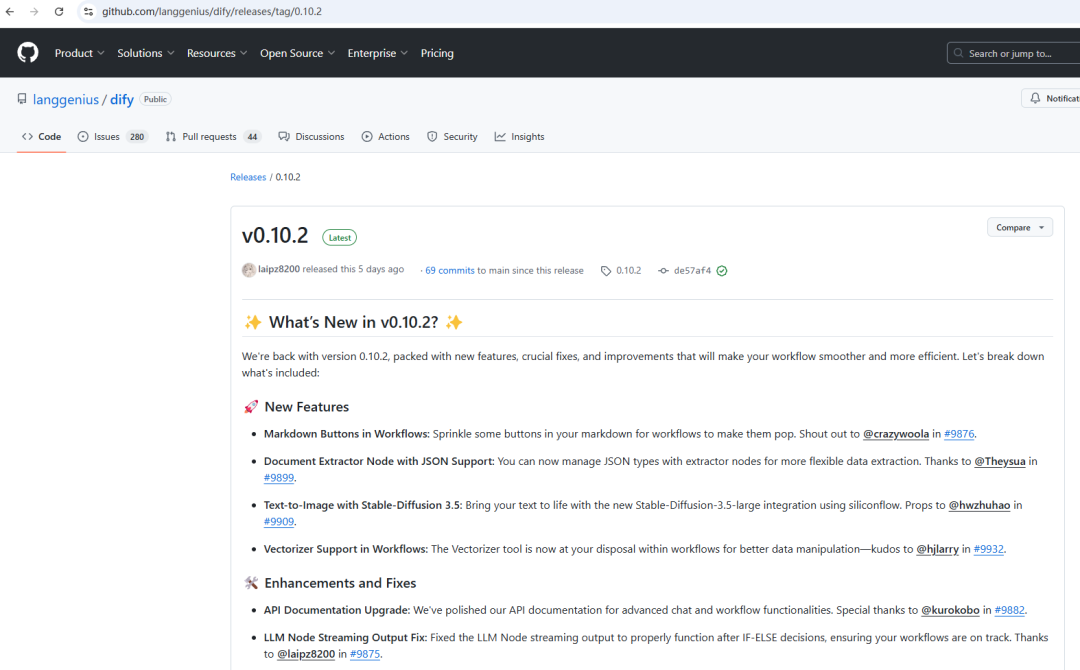

2.1. Dify源码下载

访问Diffy的github官网Release页面

https://github.com/langgenius/dify/releases/tag/1.11.4

或者通过git拉取

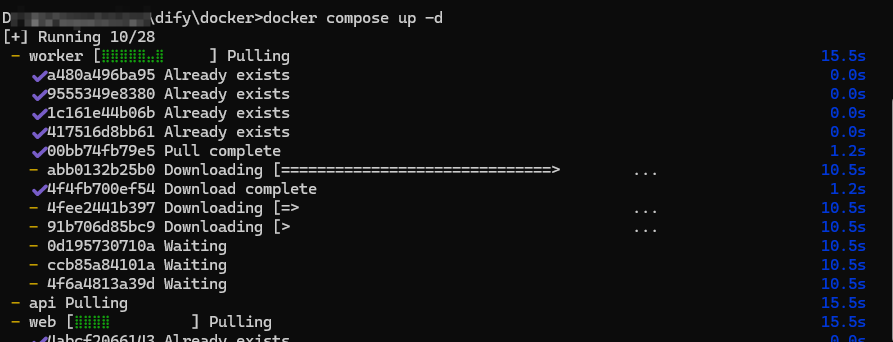

更新命令2.2. 运行Dify

硬件资源要求

CPU >= 2 Core

RAM >= 4 GiB

Docker and Docker Compose Installed

2.3. 配置管理员

首次运行要配置下管理员信息

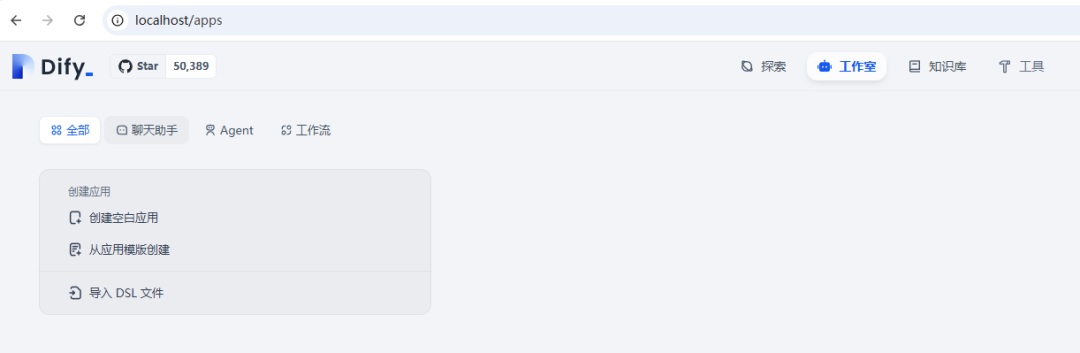

登录后界面

2.4. 配置模型

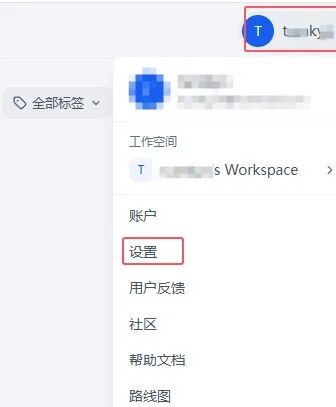

点击右上角的账号图标

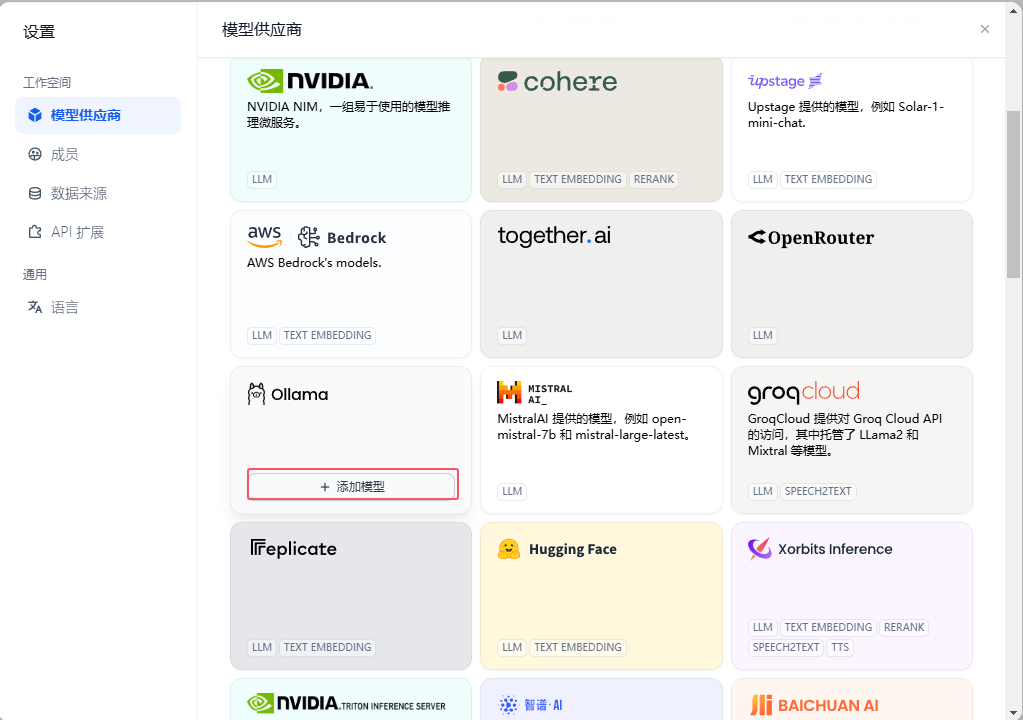

在模型供应商选择 Ollama,添加本地Ollama管理的模型

添加模型,设置这里添加 qwen2.5:1.5b 模型,在弹出的界面中:

模型名称:填写ollama list 命令列出来的模型名称,如qwen2.5:1.5b

模型基础URL:填写本地模型的URL,Win10通过Docker Destop安装的填写 http://host.docker.internal:11434

进行相关配置后,点击保存即可。

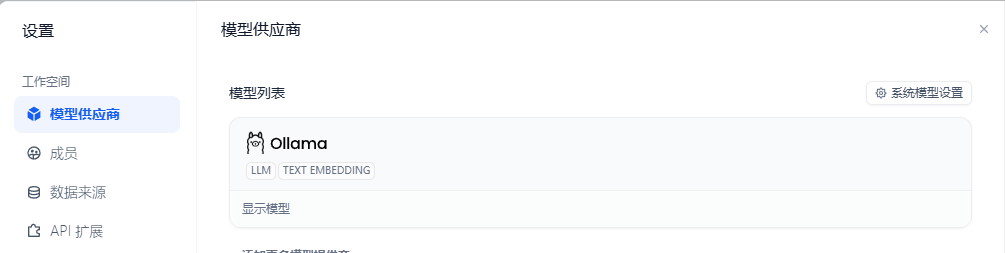

随后,在模型列表中就可以看到添加的模型

- Dify应用演示

3.1. 基础应用演示

以创建一个聊天应用为例

1、登录 本地部署的 Dify,点击“创建空白应用”

填写应用名称和描述,更加需要更换图标,这里应用类型选中 “聊天助手”,点击创建

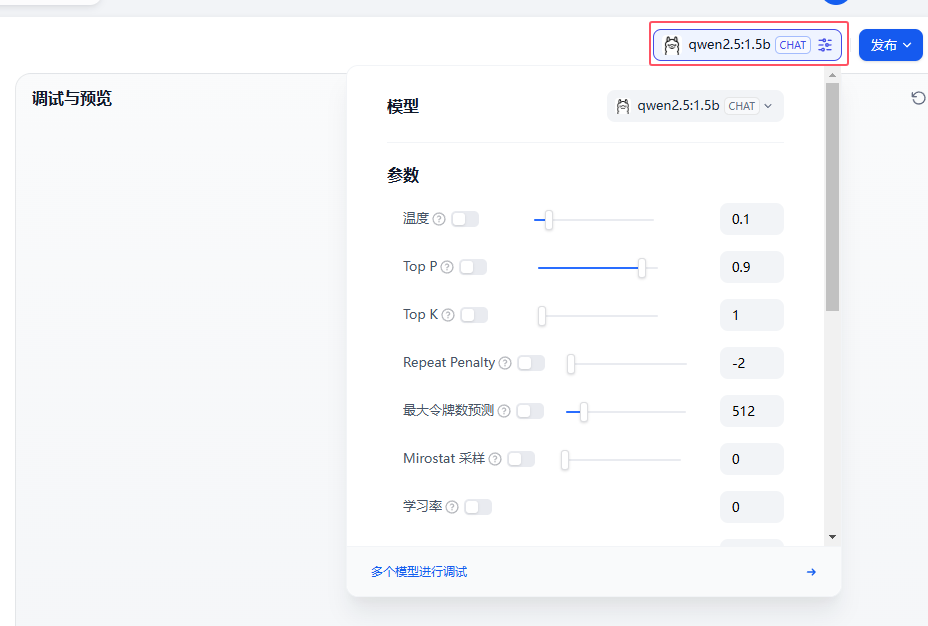

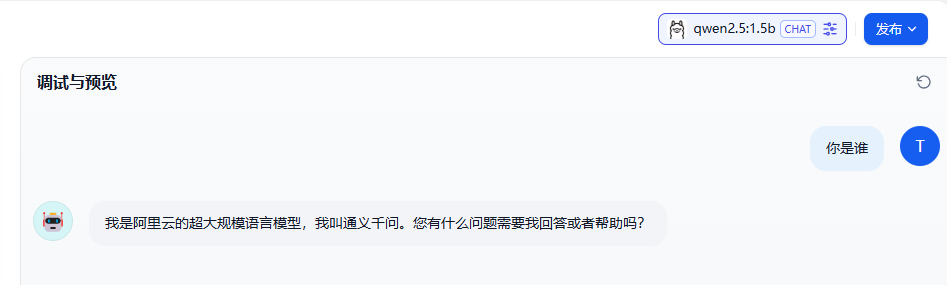

创建效果如下,得到了一个聊天应用,模型选择刚下载的qwen2.5:1.5b

可以在右边调试窗口,进行测试提问。

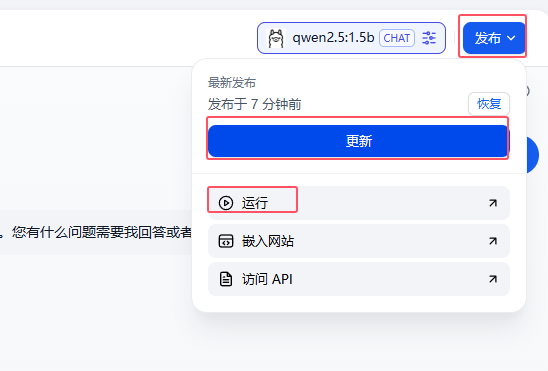

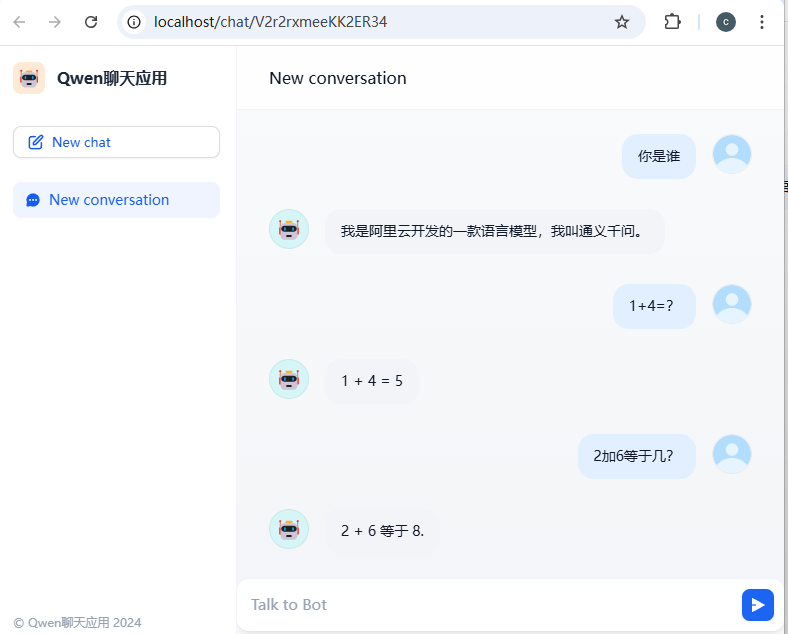

发布为网页运行

3.2. 编程助手

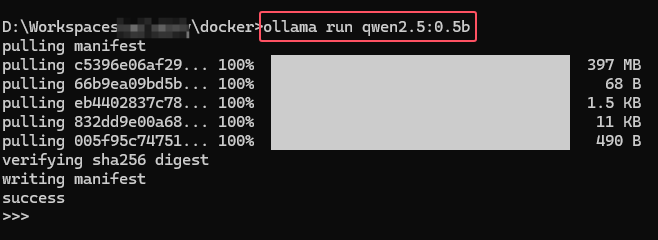

本例演示使用qwen2.5:0.5b作为编程助手

下载qwen2.5:0.5b模型

试用效果如下图:

关注公众号「碳基硅坊」,获取更多IT技术与AI实践干货!